Kollega kunde nyligen berätta att läkemedelsbolaget Astra Zeneca infört digital övervakning av personalen med syfte att kontrollera hur ofta medarbetarna är på kontoret. Unionenklubben har motsatt sig övervakningen men förhandlingarna fick inte arbetsgivaren att ändra uppfattning.

Att facket, som på Astra Zeneca, får vara med och förhandla införandet av nya IT-system tycks vara ett undantag. En ny undersökning som Unionen gjort bland förtroendevalda visar att på nio av tio arbetsplatser har facket överhuvudtaget inte fått vara med och påverka när nya digitala verktyg införts.

Övervakning en arbetsmiljöfråga

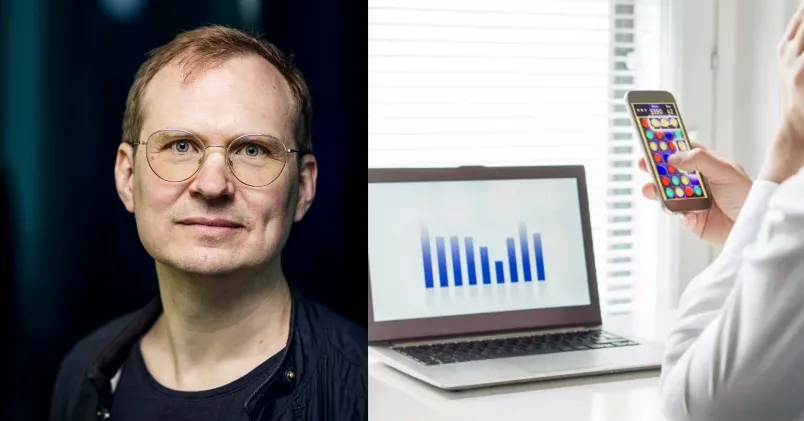

– I och med att systemen utvecklas med de här nya övervakningsfunktionerna blir det en tydlig arbetsmiljöfråga. Vi har kommit till en punkt där vi måste göra något innan situationen blir ohållbar, säger Unionens förbundsordförande Peter Hellberg.

Han påpekar att nya digitala system varit ett område som bolagens IT-avdelningar bestämt över, men när tekniken utvecklas bör arbetsgivarna tänka om. Utvecklingen med system som gör allt större intrång i den personliga sfären är något som oroar Unionen.

– Även om man är på jobbet, och inte har samma rätt till privatliv som på fritiden, finns det saker som arbetsgivaren inte har med att göra. Om inget görs är risken att det kommer att påverka arbetsmiljön negativt för många medlemmar. Missnöje och avsaknad av tillit kan leda till lägre produktivitet, säger Peter Hellberg.

Vad är orsaken till att arbetsgivare inte involverar facket i de här frågorna?

– En spekulation från min sida är att det är en kombination av okunskap och att många arbetsgivare anser det vara en icke-fråga, det vill säga att man inte anser att man använder systemen på det sätt som medarbetarna befarar.

Finns det anledning att se över lagstiftningen kring det digitala området?

– Min bild är att vi redan idag har den möjligheten i mbl (medbestämmandelagen red. anm.) Ett nytt IT-system är en påverkande fråga och då ska det mbl-förhandlas. I skrivande stund tittar vi på om det kan behövas lagstiftning på det digitala området och det kommer vi få skäl att återkomma om.

– Unionen har en handledning kring hur förtroendevalda kan förhandla de här frågorna men vi har varit lite dåliga på att sprida den. Integritet och övervakning i arbetslivet blir allt viktigare för våra medlemmar och vi måste börja ta den frågan på större allvar.